据澎湃新闻4月18日报道,人工智能开发机构OpenAI的首席执行官山姆·奥特曼最近表示,ChatGPT的研究策略——巨型AI模型模式已经结束,目前尚不清楚未来的进步究竟来自何处。

近年来,OpenAI通过采用现有的机器学习算法并将其扩展到以前无法想象的规模,在与语言一起工作的人工智能方面取得了一系列令人印象深刻的进步。GPT-4是这些项目中最新的一个,它可能是使用数万亿个文本单词和数千个强大的计算机芯片进行训练的,构建这一庞大的AI模型耗资超过1亿美元。

巨型AI模型时代已结束

据澎湃新闻4月18日报道,奥特曼上周在麻省理工学院举行的一次活动中告诉观众,新的进步不会来自于让模型变得更大。“我认为我们正处于巨型模型时代的末尾。”他说,“我们会以其他方式让它们变得更好。”科技媒体《连线》4月17日报道称,奥特曼的声明表明,在开发和部署新AI算法的竞赛中出现了意想不到的转折。未来人工智能的进步将需要新的想法。

奥特曼的声明表明,GPT-4可能是OpenAI“使模型更大并为其提供更多数据”战略中的最后一个重大进展。他没有提出什么样的研究策略或技术可能会取代它。在描述GPT-4的论文中,OpenAI估计,扩大模型规模的收益在递减。奥特曼表示,企业可以建造的数据中心数量和建造速度也存在物理限制。

有分析认为,奥特曼的这番表态意味着,在当前各科技公司都在开发和部署新AI算法、并攀比其模型规模的竞赛中,出现了出人意料的转折。自OpenAI于去年11月推出ChatGPT以来,微软已利用底层技术在其Bing搜索引擎中添加了一个聊天机器人,谷歌也推出了一个名为Bard的聊天机器人来与之竞争。许多公司纷纷推出类似的聊天机器人以显示自己不甘人后。

同时有分析认为,奥特曼的这一表态可能意味着,GPT-4或许是OpenAI使模型更大并为它们提供更多数据的战略中出现的最后一个重大进展。奥特曼并没有说什么样的研究策略或技术可能会取代它。

Cohere的联合创始人尼克·弗罗斯特(Nick Frosst)表示,奥特曼的想法听起来是对的。他也认为,Transformer(GPT-4及其竞争对手的核心机器学习模型类型)的进展超出了扩展范围。“有很多方法可以让Transformer变得更好、更有用,而且很多方法不涉及向模型添加参数。”他说,新的AI模型设计或架构,以及基于人类反馈的进一步调整是许多研究人员已经在探索的有前途的方向。

同日,在麻省理工学院举行的一个讨论商业和人工智能的会议上,奥特曼还表示,“我们现在并没有训练GPT-5,目前只是在GPT-4的基础上进行更多的工作而已。”此前有报道称,预计到2023年底,GPT-4将被新的GPT-5版本取代。对于科技节领袖暂停超强AI训练的联名信,奥特曼也在采访中首次做了回应,称他同意这封信的部分内容,但信中“遗漏了关于我们需要暂停的大部分技术细节。”

AI技术在欧洲面临进一步监管

值得一提的是,OpenAI的CEO奥特曼还回应称,马斯克等人呼吁将AI研发工作暂停六个月的公开信缺乏“技术细节”。他也认为,需要提高AI的安全指导意见。但公开信并非正确的解决之道。

据中新经纬4月18日援引《华尔街日报》当地时间17日报道,欧盟的立法者希望赋予监管机构新的权利来管理ChatGPT等技术的开发。报道指出,当地时间周一,欧盟的立法者计划于当日发表一封公开信并指出,随着人工智能飞速发展,有必要为这些人工智能工具制定一套强大的新规则以规范其应用。负责起草欧盟人工智能法案新草案的立法者小组指出,他们致力于在法案中增加相关条款,旨在“引导强大的人工智能朝着以人为本、安全可靠的方向发展”。

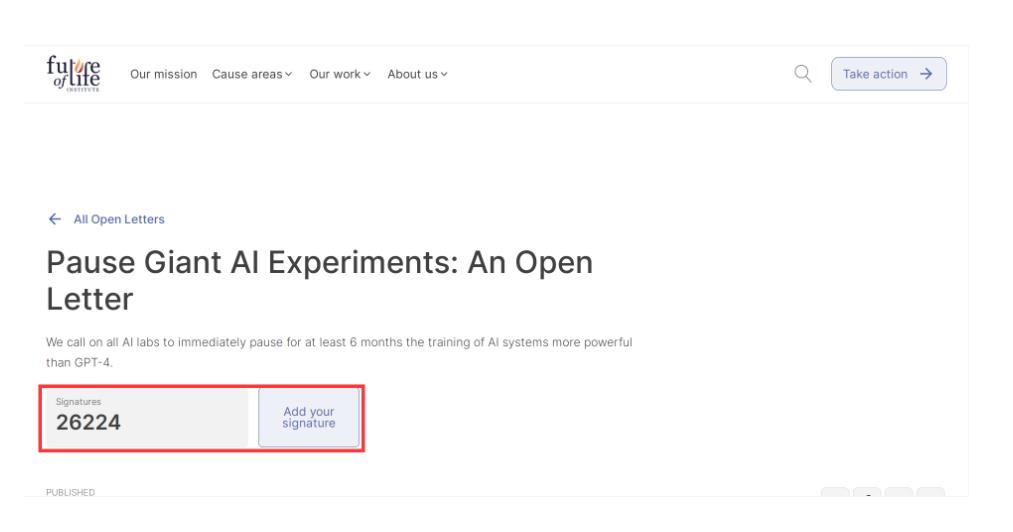

3月末,生命未来研究所(Future of Life)发布了一封公开信,包括马斯克等大佬在内超2.6万人进行了签名,呼吁所有人工智能实验室暂停比GPT-4更强大的人工智能系统的训练,暂停时间至少为6个月。

据每日经济新闻4月11日报道,因强大功能而爆红的ChatGPT正因数据隐私和安全风险在全球掀起一场监管风暴。继意大利宣布暂时封禁ChatGPT之后,德国也表示正在考虑暂时禁用。紧随其后,法国、爱尔兰、西班牙等欧洲国家的监管机构也相继表达了类似可能性。与此同时,加拿大的隐私监管机构已经宣布对OpenAI展开调查,美国方面也在探讨加强对AI的监管。不仅如此,由于生成了虚假内容,ChatGPT恐将在澳大利亚面临全球首例诽谤诉讼。

近日,研究人员Noah Shinn和Ashwin Gopinath在预印本网站arxiv提交论文称,通过引入“反思”技术,GPT-4在多项高难度测试中的表现提升了30%。据悉,这种技术让AI系统模仿人类的自我反思,并评估自己的表现,“GPT-4在完成各种测试的时候,会增加一些额外的步骤,让它能够自己设计测试来检查自己的答案,找出错误和不足之处,然后根据发现来修改自己的解决方案。”

爱尔兰数据保护委员会以及中国人民大学高瓴人工智能学院教授卢志武认为,AI学会自我迭代所产生的后果难以具体想象,但如果一个东西在不停地变强而人类却不知道,这是“最可怕的”。未来,假如AI模型和机器人进行结合,则AI就可以产生动作,“你都不知道它是不是会拿起枪来做什么事情”。

而实际上,科学家已经在探索如何将生成式AI与机器人相结合。微软的科学家2月份发布论文称,他们正在研究利用ChatGPT来操控机器人,以实现以自然语言与机器人交互的目的,并展示了无人机和机械臂的操作案例。

环球产经网

环球产经网